🚀 A CloudSEK se torna a primeira empresa de segurança cibernética de origem indiana a receber investimentos da Estado dos EUA fundo

Leia mais

Segurança de IA significa proteger os sistemas de IA contra ataques e, ao mesmo tempo, usar a IA para fortalecer a segurança cibernética de uma organização. Ele mantém os dados, os modelos e os processos de decisão dentro desses sistemas robustos, privados durante a inferência e resistentes à manipulação.

Ameaças como entradas adversárias, envenenamento de dados, inversão de modelos e extração de modelos têm como alvo a forma como os modelos de aprendizado de máquina aprendem e respondem às informações. Esses ataques exploram lacunas nos dados de treinamento ou no comportamento de inferência que as ferramentas de segurança tradicionais não foram criadas para detectar.

À medida que a IA se torna parte de operações críticas, proteger esses sistemas é essencial para uma tomada de decisão confiável e segura. Ao mesmo tempo, a IA oferece às equipes de segurança cibernética uma visão antecipada de atividades suspeitas, ajudando-as a detectar ameaças com mais rapidez e agir com maior confiança.

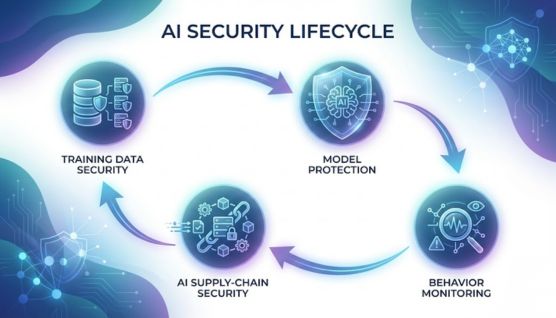

A segurança da IA funciona protegendo os dados, os modelos e os canais operacionais que alimentam os sistemas de inteligência artificial durante todo o ciclo de vida.

Os dados de treinamento precisam ser verificados quanto à precisão, proveniência e sinais de adulteração antes de moldarem a forma como um modelo aprende. Isso reduz as chances de ataques de envenenamento e ajuda a manter a integridade do conhecimento subjacente do sistema.

Os modelos são protegidos por meio de controles de acesso, criptografia, limites de taxa e outras salvaguardas que impedem tentativas de extração ou inversão. Essas proteções ajudam a manter a confidencialidade da lógica do modelo e reduzem o risco de invasores influenciarem seus resultados.

O monitoramento contínuo detecta desvios, entradas estranhas ou decisões inesperadas que podem sinalizar um comprometimento. Essa visibilidade permite que as equipes de segurança respondam rapidamente quando um modelo começa a se comportar fora de seus padrões normais.

A segurança da cadeia de suprimentos de IA se concentra na verificação dos conjuntos de dados, componentes do modelo e ferramentas de terceiros usadas para criar e executar um sistema de IA. Ele ajuda as equipes a detectar dados envenenados, dependências inseguras ou bibliotecas comprometidas antes que eles influenciem o desempenho do modelo na produção.

A IA aprimora a segurança cibernética detectando ameaças, analisando comportamentos e identificando padrões maliciosos que as ferramentas tradicionais podem ignorar.

A IA fortalece plataformas como SIEM e EDR correlacionando grandes volumes de eventos de segurança para descobrir ameaças ocultas ou emergentes. Esses modelos identificam sinais de alerta precoce, como atividade coordenada de sondagem ou comportamento incomum do sistema, que podem sinalizar um ataque em andamento.

Os sistemas de aprendizado de máquina estudam como usuários e dispositivos normalmente operam para destacar ações que estão fora das linhas de base comportamentais normais. Isso ajuda a descobrir riscos sutis, como tentativas incomuns de login, padrões anormais de acesso a dados ou desvios que podem indicar credenciais comprometidas.

A IA analisa sinais de comunicação, padrões de conteúdo e interações do usuário para revelar tentativas de phishing, campanhas de falsificação de identidade e outras formas de fraude digital. Esses modelos também detectam indicadores de roubo de dados e esquemas de engenharia social ao aprender como agentes mal-intencionados adaptam suas táticas ao longo do tempo.

A IA ajuda a evitar ataques cibernéticos detectando sinais precoces de atividades maliciosas, acelerando a detecção e automatizando ações defensivas em ambientes digitais.

Os criminosos usam a IA para escalar ataques, melhorar a fraude e automatizar técnicas que, de outra forma, levariam muito tempo e experiência para serem executadas.

Os atacantes usam vídeos gerados por IA e clonagem de voz para se passar por executivos, funcionários ou clientes durante tentativas de fraude de alto valor. Esses deepfakes tornam os esquemas de engenharia social mais convincentes e difíceis de identificar pelos alvos.

Os agentes de ameaças confiam em modelos de IA para produzir novas variantes de malware que evitam a detecção baseada em assinaturas e se adaptam aos controles defensivos. Essas ferramentas ajudam os invasores a refinar cargas úteis, automatizar a geração de código e identificar pontos fracos nos sistemas visados.

As ferramentas de IA criam mensagens de phishing altamente personalizadas e orquestram interações automatizadas de bate-papo, e-mail ou voz que imitam a comunicação humana. Esses modelos geram conteúdo realista, ajustam o tom dinamicamente e orientam as vítimas a revelar credenciais ou informações confidenciais.

Os sistemas de IA enfrentam ameaças especializadas que visam seus dados, modelos e lógica de decisão de maneiras que as medidas de segurança tradicionais não foram projetadas para detectar.

Os invasores modificam as entradas de maneiras sutis para induzir os modelos de IA a fazerem classificações incorretas ou decisões inseguras. Essas manipulações exploram a sensibilidade do modelo a pequenas perturbações que parecem normais para observadores humanos.

Os ataques de envenenamento envolvem a inserção de amostras maliciosas ou enganosas em conjuntos de dados de treinamento para distorcer a forma como um modelo aprende. Essas alterações podem permanecer ocultas até que o modelo seja implantado, resultando em resultados tendenciosos ou prejudiciais.

A inversão do modelo permite que os atacantes reconstruam informações confidenciais usadas durante o treinamento, examinando as saídas do modelo. Isso expõe dados privados e prejudica a confidencialidade, mesmo quando o modelo parece seguro.

Os ataques de extração replicam a lógica ou os limites de decisão de um modelo consultando-o repetidamente e analisando os resultados. Isso permite que os adversários roubem propriedade intelectual ou usem o modelo clonado para fins maliciosos.

A injeção imediata manipula grandes modelos de linguagem fornecendo instruções criadas que substituem ou redirecionam o comportamento pretendido. Isso leva a resultados não intencionais e cria oportunidades de uso indevido ou exposição de dados.

As técnicas de desbloqueio exploram as fraquezas nas salvaguardas do modelo para contornar os filtros de segurança e permitir ações ou respostas restritas. Esses ataques prejudicam a integridade das grades de proteção que protegem contra saídas nocivas ou sensíveis.

A segurança da IA é importante porque as organizações agora contam com sistemas de aprendizado de máquina para tomar decisões e automatizar tarefas que devem permanecer precisas e confiáveis.

A IA está se tornando profundamente incorporada às principais operações, portanto, proteger esses sistemas é essencial para manter a confiabilidade, proteger os dados e reduzir o impacto de possíveis interrupções.

Várias estruturas conhecidas oferecem orientação prática para entender os riscos da IA, aplicar os controles corretos e manter os sistemas responsáveis à medida que evoluem.

A estrutura de gerenciamento de riscos de IA do NIST ajuda as equipes a avaliar como um sistema de IA se comporta e onde ele pode estar exposto ao risco. Ele fornece uma forma estruturada de melhorar a confiabilidade por meio de melhores medições, monitoramento e governança.

ISO/IEC 42001 descreve como as organizações devem gerenciar as operações de IA por meio de processos, documentação e supervisão claros. Ele oferece suporte à implantação consistente e responsável, alinhando as equipes em torno de padrões e controles compartilhados.

A Lei de IA da UE define regras com base no nível de risco que um sistema de IA apresenta e define quais salvaguardas devem estar em vigor. Ele enfatiza a transparência, a proteção de dados e o monitoramento contínuo de aplicativos usados em áreas sensíveis ou de alto impacto.

O Top 10 do OWASP para LLMs destaca os problemas de segurança mais frequentes observados em aplicativos de grandes modelos de linguagem, como manipulação rápida e tratamento inseguro de saída. Ele oferece aos profissionais uma lista de verificação clara para identificar vulnerabilidades e fortalecer os sistemas generativos de IA.

Estrutura de IA segura do Google incentiva as equipes a criar modelos de IA com fortes fundamentos de segurança, desde a validação de entradas até o monitoramento contínuo. Ele trata a IA como parte de um ecossistema de segurança mais amplo e promove práticas de proteção em dados, modelos e infraestrutura.

A forte segurança da IA vem da combinação dos controles técnicos corretos com supervisão clara e monitoramento consistente em todo o ciclo de vida de um modelo.

Escolher uma solução de segurança de IA significa avaliar se ela oferece suporte às operações do mundo real, se adapta aos riscos em evolução e se integra ao seu ambiente de segurança existente.

Os modelos de IA dependem de padrões nos dados, o que os torna suscetíveis a pequenas manipulações criadas para influenciar seus resultados. Os invasores exploram essa sensibilidade alterando as entradas ou corrompendo os conjuntos de dados usados para treinar o modelo.

Os ataques comuns incluem entradas adversárias, envenenamento de dados, extração de modelos e manipulação imediata. Cada técnica interfere na forma como um modelo aprende, classifica ou gera informações.

Sim, os atacantes podem influenciar o comportamento do modelo fornecendo informações elaboradas ou enganosas durante a inferência. Esses ataques são bem-sucedidos mesmo quando a infraestrutura subjacente permanece segura.

A IA analisa comportamentos, padrões e anomalias para identificar atividades que seriam difíceis de serem detectadas pelas ferramentas tradicionais. Isso melhora a detecção precoce e ajuda as equipes a entender os riscos potenciais com mais rapidez.

Os modelos de IA podem revelar dados de treinamento se forem investigados ou implantados sem os controles de privacidade adequados. Fortes restrições de acesso e monitoramento ajudam a evitar esses vazamentos.

Todos os sistemas de IA se beneficiam das principais proteções porque até mesmo aplicativos de baixo risco podem ser mal utilizados ou manipulados. Os sistemas de alto impacto exigem proteções mais fortes devido à gravidade de possíveis falhas.

Eles devem começar validando os dados de treinamento, revisando o comportamento do modelo e limitando o acesso a componentes confidenciais. O monitoramento contínuo ajuda a identificar precocemente mudanças inesperadas ou sinais de uso indevido.

O CloudSEK usa IA para monitorar o cenário de ameaças externas e identificar riscos direcionados à sua marca, dados e ativos digitais. Sua plataforma analisa sinais na Internet para detectar fraudes, tentativas de falsificação de identidade, vazamentos de dados e vulnerabilidades antes que se transformem em incidentes.

O CloudSEK fornece às organizações visibilidade antecipada das ameaças combinando aprendizado de máquina, monitoramento contínuo e alertas automatizados. Isso ajuda as equipes de segurança a agir rapidamente, reduzir a exposição e fortalecer a proteção contra riscos externos.

Alertas em tempo real: Envia notificações oportunas quando a IA do CloudSEK detecta riscos emergentes ou padrões suspeitos.